Поведенческие факторы при продвижении сайта — какие способы улучшения ПФ допустимы, а какие считаются накруткой

Сегодня будет статья на тему, о которой говорят уже все кому не лень — поведенческие факторы. На самом деле уже многие в курсе что это такое, да и я сам около полугода назад писал о пользовательских характеристиках, как одном из трех китов, на которых стоит продвижение сайтов в современных условиях.

Особенный резонанс влияние поведенческих факторов, а точнее их накрутка, получили в последнее время. Яндекс с конца мая начал пессимизировать ресурсы, использующие различные способы накрутки поведения пользователей на сайте. Причем, все это было сделано с большой помпой, под горячую руку попало очень много ресурсов и в том числе лидеры области SEO (платного продвижения). Все это получило большую общественную огласку (ролик в новостях по ТВ, статья в ведомостях, масса публикаций и обсуждений в интернете).

Поведенческие факторы — история появления

Т.е. Яндекс сотворил эдакую показательную порку всех тех, кого ему далось поймать за руку на накрутке поведенческих факторов продвижения (а с точки зрения поисковых систем — ранжирования сайтов и определения релевантности документов поисковому запросу). Понятно, что как только оптимизаторы поняли, что за накрутку поведения посетителей можно попасть под фильтр, то тут же стали пытаться завалить таким не хитрым способом своих конкурентов.

Вроде бы как даже всего нескольких оплаченных, например, в юзаераторе (один из многочисленных сервисов предлагающих услуги накрутки пользовательских характеристик) кликов по сайтам конкурентов из поисковой выдачи Яндекса было достаточно для того, чтобы отправить этого конкурента под фильтр. В результате, по тем запросам, по которым продвигался данный ресурс с помощью накрутки ПФ, он резко выпадал за Топ 100.

Наверное, большинству из вас, уважаемые читатели, понятно, что до бесконечности так продолжаться не могло и сейчас поисковик номер один в рунете уже не наказывает за подобную накрутку, но это вовсе не значит, что теперь все могут бросать это делать. Скорее всего у Яндекса сейчас работает алгоритм, который просто нивелирует (обнуляет) влияние накрутки, тем самым полностью сводя на нет результат от этого способа продвижения.

Но давайте вернемся к тому, что такое поведенческие факторы, на какие группы они подразделяются, какие способы накрутки ПФ существовали (и продолжают существовать, но уже не будут иметь такой сумасшедшей популярности), как Яндекс, да и мы с вами, можем определить, что на ресурсе проводилась накрутка ПФ, и какие существуют «белые» способы улучшения влияния ПФ на продвижение (возможно ли продвижение сайта самостоятельно).

Итак, откуда и когда именно появилось понятие пользовательских факторов, и какая из поисковых машин стала его первой использовать? Кто-то считает, что еще в 2004 году после появления алгоритма Флорида в Google (сейчас текущий алгоритм уже называется Панда) эта поисковая система стала активно учитывать ПФ на ресурсе, и именно тогда произошло проседание многих искусственно накрученных и накачанных ссылками сайтов.

Также достоверно известно, что не безызвестная компания Микрософт (имеющая непосредственно отношение к поисковику Bing) в 2008 опубликовала документ, поясняющий принцип работы такого показателя как Browserank, который судя по опубликованному документу должен был стать гораздо более эффективным инструментом, чем разработанный гораздо раньше поисковиком Google всем вам известный ПейджРанк.

Если обобщать, то Browserank в какой-то степени является аналогом pagerank, но при этом вес отдельных документов в сети оценивается не по проставленным ссылками, а по конкретным осуществленным переходам по этим ссылкам, т.е. по кликам. При использовании Browserank гораздо более высокие позиции в поисковой выдачи должны были получить сайты социальных сетей и других ресурсов, где пользователи проявляют большую активность (кликают).

Ну, и относительно недавно об учете пользовательских характеристик заговорил и Яндекс. Так почему же всем без исключения поисковикам, которые хотят иметь актуальную и релевантную выдачу, нужно учитывать ПФ? Наверное, просто потому, что два других основных фактора, на которые обращали поисковики свое внимание при ранжирования документов, уже себя изжили. Я говорю об анализе непосредственно контента документа и анализа проставленных на этот документ ссылок.

Нет, конечно же, текст и ссылки по-прежнему влияют на ранжирование, но они уже не могут оказывать решающего влияния из-за того, что сильно дискредитированы, попросту заспамлены. Сначала оптимизаторы (вот, гады) заспамили тексты и все те факторы текстовой оптимизации, на которые обращали особое внимание поисковые системы (ключевые слова в заголовках, тегах выделения, мета тегах и т.п.).

А потом эти самые оптимизаторы (чтоб им) заспамили и ссылочные факторы, на которые поисковики поначалу возлагали очень большие надежды, ибо текст оптимизировать совсем не сложно, а вот ссылки на себя проставлять ведь нужно с других ресурсов, что значительно сложнее.

Но данную проблему решили биржи ссылок, например:

Они стали посредниками между теми, кто желал заработать денег в сети продажей ссылок со своего сайта, и теми, кто желал получить преимущество в продвижении, купив нужное количество бэклинков с нужными анкорами.

Теперь использование в качестве анкоров (текста обратных ссылок) ключевых слов, по которым продвигается ваша статья (подбор ключевых слов в Slovoeb), стало равнозначно тому, как будто бы вы сами сообщили поисковику (в письменной форме) о том, что данные ссылки являются покупными. Нет, конечно же, они хоть и знают, что ссылка покупная, но все равно могут ее учитывать, но встает вопрос, а насколько учитываются они при ранжировании.

Для некоммерческих поисковых запросов велика вероятность того, что покупная ссылка (с оптимизированным анкором) вообще учитываться не будет, а вот для коммерческого запроса эти ссылки по-прежнему работают, но с такими большими оговорками, что, пожалуй, вам никто не даст точного ответа как именно. Все оптимизаторы покупают бэклинки, но многие уже начинают улучшать позиции сайта не покупкой дополнительных ссылок, а, наоборот, снятием заведомо плохих. Вот как извратили такую хорошую идею.

В общем, Яндекс и Гугл по-прежнему учитывают оптимизированность текстов и проставленные обратные ссылки, но уже с очень и очень большим количеством оговорок. И тут как раз очень кстати пришлись поведенческие факторы.

Если попробовать проследить за поведением пользователей в выдаче, а так же на сайтах (страницы которых должна ранжировать поисковая машина), то можно при должном умении извлечь из этого очень много полезной информации, позволяющей лучше настроить ранжирование по всем запросам и получить выдачу еще более релевантную им.

Получается своеобразная обратная связь, когда сами посетители своими действиями подтверждают или, наоборот, опровергают право нахождения данного ресурса на данной позиции в поисковой выдаче.

Но тут опять же все не «здорово живешь». Во-первых, снова возникает угроза того, что пользовательские факторы очень быстро заспамят (что, собственно, и происходит), а во-вторых, нужно не просто собрать информацию о поведении посетителей и в поисковой выдаче (для поисковиков это не проблема), и на самих пользовательских ресурсах (где им статистику собрать сложнее, но тоже можно), а еще ее и интерпретировать либо в плюс, либо в минус.

Но давайте обо всем поговорим по порядку и попробуем разложить информацию по полочкам.

Расчет поведенческих факторов в выдаче и на сайте

Итак, давайте подумаем, на что и где именно могут обращать внимание поисковики при анализе ПФ. Вообще принято считать, что они отслеживают поведение пользователей в двух основных местах:

Давайте посмотрим, на что могут обращать внимание поисковые системы при учете поведения пользователей в поисковой выдаче:

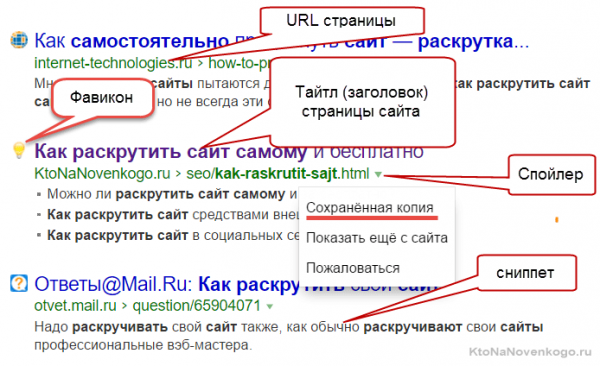

CTR — соотношение числа переходов на сайт из выдачи к числу просмотров информации о нем (title, сниппет, Url) все в той же выдаче. Т.е. по идее, чем выше CTR, тем более привлекательным должен быть ресурс и тем выше он сможет переместиться. Понятно, что тут все не так гладко, ибо изначально находящиеся в верхней части страницы ресурсы будут по умолчанию иметь более высокий СТР.

Хотя, конечно же, этот пользовательский фактор поможет отсеять из топа сайты с совсем уж топорным сниппетом и тайтлом. Думаю, что методы повышения этого ПФ для всех проектов будут одинаковыми.

Как улучшить поведенческие характеристики в поисковой выдаче:

Так же поисковики, возможно, обращают внимание на такой поведенческий фактор, как возврат пользователя обратно в выдачу после перехода на ваш вебсайт. Наверное, это в купе с другими характеристиками может сказать о том, что пользователь не нашел на вашем ресурсе то, что он искал. Думаю, что после определенного момента за такие возвраты ваш проект может быть понижен в выдаче, но опять же все это, скорее всего, учитывается в совокупности.

Кстати, одной из причин такого поведения пользователей может быть то, что вы оптимизировались (например, закупкой ссылок) под тот запрос, суть которого не раскрыта на приземляющей странице (той, на которую перейдет пользователь из выдачи). Нужно стремиться сделать трафик с поисковых систем максимально целевым, ибо в результате анализа пользовательских характеристик вас все равно рано или поздно выкинут из Топа по «не вашим» запросам. Проверено на собственном опыте.

Как поисковики узнают о поведение людей на сайте и на что смотрят

Понятно, что из своей собственной выдачи и Яндекс, и Google смогут вытянуть всю необходимую им информацию о ПФ, но вот непосредственно на пользовательских проектах у них такой власти уже нет. Но тем не менее поисковые системы с успехом решают данную задачу, а значит мы сможем предположить как это им удается.

Итак, как же Яндекс и Google смогут оценить поведение пользователей на вашем сайте:

Наверное, можно и еще чего-нибудь придумать, но и этого вполне хватает, чтобы понять, что поведение посетителей на любом ресурсе рунета для Яндекса (и Гугла) в той или иной степени не будет являться секретом.

Но ведь пользователи это не асессоры Яндекса, которым специально платят зарплату за то, чтобы они давали оценки веб проектам по целому ряду позиций. Им денег никто не платит и то, как понимать их действия, Яндексу придется как-то решать самому, используя логику и силу программистской мысли.

Причем, один и тот же показатель поведенческих факторов для ресурсов разных тематик может означать в одном случае хорошо, а в другом — не очень.

Так, а теперь давайте подумает, какие ПФ на сайте могут учитывать поисковиками:

Анализ пользовательских факторов и способы их улучшения

Если с последним пунктом все ясно, то вот по первым трем такой ясности и однозначности нет. Судите сами, у интернет магазина (а еще даже лучше для примера подойдут доставка пиццы или заказ такси) может быть очень короткая сессия и показатель отказов близкий к ста процентам (посетитель зашел на страницу, увидел номер контактного телефона и ушел звонить), но тем не менее сам интернет магазин может быть очень хорошим и будет хорошо ранжироваться в Яндексе.

Для новостного же портала или блога, подобного тому что вы сейчас читаете, показатель отказов в 100% (ваш ресурс пользователям, скорее всего, не интересен) или даже в 90% будет катастрофой, которая лишит его львиной доли трафика с поисковых систем.

Т.е. ПФ учитываются Яндексом и другими поисковиками сугубо избирательно. Видимо существуют определенные срезы сайтов по тематикам, для которых у Яндекса есть усредненные показатели поведенческих факторов и с которыми будут сравниваться все другие ресурсы отнесенные к этому же срезу.

Т.е. слишком низкий показатель отказов для магазина по доставке пиццы может быть интерпретирован поисковиками как не очень положительный ПФ (пользователи слишком долго ищут нужный им телефон для заказа), и возможно что позиция этого ресурса будет несколько скорректирована в худшую сторону. Но думаю, что по одному единственному поведенческому показателю такое решение вряд ли будет выноситься.

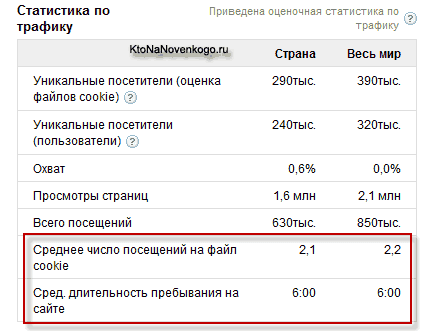

Как узнать, какие значения ПФ будут нормальными именно для вашего ресурса? У Гугла есть масса полезных сервисов, которыми мало кто пользуется, например, все тот же DoubleClick Ad Planner, который я толком и не понимаю для чего нужен, но вот его данные могут нам пригодиться в оценке пользовательских факторов собственного проекта.

Введя на этой странице (для входа на нее нужно иметь аккаунт, т.е. быть зарегистрированным в Google) в поле «Просмотреть данные о сайте» URL своего ресурса, вы получите массу полезной информации о своем веб проекте. В области «Статистика по трафику» в двух самых нижних строчках вы как раз и увидите ваши пользовательские характеристики:

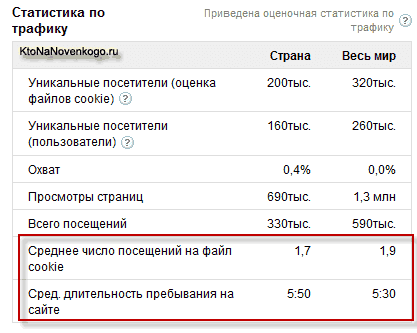

Надеюсь, что вы знаете другие ресурсы в вашей тематике, с которыми можете сравнить имеющиеся у них и у вас поведенческие факторы. Я, например, сравнил свой блог с проектом Михаила Шакина, который имеет по мнению DoubleClick Ad Planner такие ПФ:

Если вы таких ресурсов не знаете, то посмотрите что вам присоветует сам Ad Planner в области «Также посещенные сайты». Как бы это один из, наверное, многих способов проверки соответствия ваших поведенческих факторов стандартам принятым в вашей нише.

Теперь еще осталось сказать пару слов про белые способы улучшения пользовательских характеристик для своего сайта:

Запрещенные способы и методы накрутки ПФ

Так, а теперь давайте посмотрим, какие такие накрутки поведенческих факторов занимали умы многих оптимизаторов и оптимизаторских контор до недавнего времени. Насколько я понимаю, накручивали именно поведение в поисковой выдаче Яндекса, а не непосредственно на сайте.

Причем, можно выделить два вида накрутки:

Накрутка ПФ через ботнет, т.е. через сеть зомбированных вирусом компьютеров по всему миру. Владельцы компьютеров зараженных вирусом при этом обычно ничего не замечают и спокойно шарятся по интернету, а скрипт вируса заходит в выдачу Яндекса по нужному запросу и осуществляет от имени этого пользователя переход на нужный сайт.

Что примечательно, данный вирус еще умеет подменять рекламные объявления на ресурсах, по которым ходит владелец зараженного компьютера на другие (заказанные). Но это только по слухам (читайте про мою эпопею заражения сайтов вирусами и их проверки). Вообще, ботнет — это уже уголовно наказуемое преступление, а сотрудничество с его хозяином, наверное, равносильно скупке краденного. Собственно, сам Яндекс говорит о том, что за такой способ накрутки (равно как за другие) он будет наказывать.

Накрутка поведенческих факторов вручную за счет армии не шибко дорогих кликеров из бирж подобных юзератору. Т.е. оптимизатор давал задание набрать в поисковой строке Яндекса определенный запрос, а затем перейти со страницы открывшейся поисковой выдачи на нужный сайт.

На первый взгляд такой способ может показаться очень даже приемлемым, ибо получается дешево и сердито, а связать клики совершенно различных (физических) пользователей с юзератором или другим сервисом накрутки, казалось бы очень сложно. Но это только казалось.

Собственно, даже не нужно быть Яндексом, чтобы понять, что, например, самый известный из зафильтрованных проектов Megaseo накручивал ПФ. В общем-то, они и сами это признали, но тем не менее достаточно зайти на Alexa (кстати, Alexa появился даже раньше Гугла, хоть и не стал столь успешным) и перейти на страницу с данными по Megaseo:

http://www.alexa.com/siteinfo/megaseo.ru

Переходите на вкладку «Clickstream»:

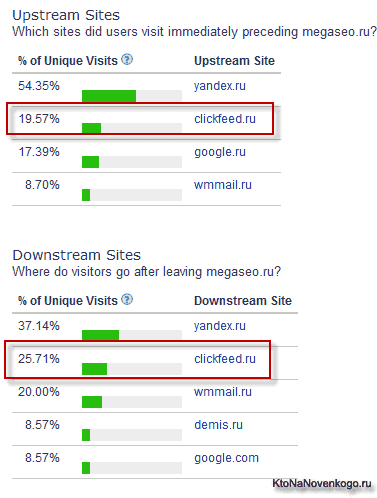

И видите следующую картину:

Как объясняют знающие люди, выделенный на скриншоте домен является персональным сервисом накрутки, на который могли попасть только пользователи зарегистрированные в Megaseo. Возможно именно поэтому получилось так, что «уши из под шапки видны».

Немного поясню по последнему скриншоту. В верхней табличке приведены ресурсы, с которых люди чаще всего заходили на Megaseo, а внизу, на которые посетители чаще всего уходили с этого зафильтрованного оптимизаторского ресурса.

В общем-то, если уж обычные смертные с их куцыми способами и средствами способны заподозрить что-то неладное, то что уж говорить про Яндекс. Он все знает и все видит. И в общем-то, он показательно дал сильную затрещину самым зарвавшимся накрутчикам ПФ, а дальше он, скорее всего, вообще перестанет учитывать подобные вещи (т.е. будет обнулять влияние накрутки поведенческого). Иначе в юзераторе конкуренты начнут заказывать друг друга на попадание под фильтр.

Удачи вам! До скорых встреч на страницах блога KtoNaNovenkogo.ru

Источник: ktonanovenkogo.ru